youxihw下载站:汇聚最热门软件,安全、高速、放心的专业下载站!

怎样借助Unsloth在NVIDIAGPU上对大语言模型(LLM)开展微调工作

这些应用场景包括让聊天机器人处理产品支持问题,或作为管理日程的个人助理。但如何让小语言模型(SLM)在执行专用的代理式任务时持续以高准确率进行响应,仍然是一个挑战。

这正是微调发挥作用的地方。

Unsloth 是全球范围内使用最为广泛的开源大语言模型(LLM)微调框架之一,为模型定制工作提供了一条简单易操作的实现路径。该框架专门针对 NVIDIA GPU 展开了训练层面的优化,具备高效运行、显存占用低的特点,其适用范围涵盖 GeForce RTX 系列的台式机与笔记本电脑、RTX PRO 工作站,还包括全球体积最小的 AI 超级计算机 DGX Spark。

另一个强大的微调起点是刚刚发布的 NVIDIA Nemotron 3 系列开放模型、数据和代码库。Nemotron 3 引入了目前最高效的开放模型系列,适合用于代理式 AI 的微调。

教会 AI 新招式

微调就像是为 AI 模型进行一次有针对性的训练。通过与特定主题或工作流程相关的示例,模型可以学习新的模式并适应当前任务,从而提升准确性。

为模型选择哪种微调方法,取决于开发者希望对原始模型进行多大程度的调整。根据不同目标,开发者可以采用三种主要的微调方法之一:

参数高效微调(如 LoRA 或 QLoRA):

工作原理:仅对模型的局部进行更新,以此实现更快速、更经济的训练过程。这种方法能够在不显著改变模型整体结构的前提下,高效地增强其能力。适用场景:基本覆盖了所有原本需要进行完整微调的传统场景,例如融入特定领域的专业知识、提高代码生成的精准度、让模型更好地适配法律或科学领域的任务、优化推理分析能力,以及对模型的语气风格和行为模式进行调整以符合需求。应用要求:需要使用小规模至中等规模的数据集,具体范围为包含100到1000组示例提示词对的数据集。

完整微调:

工作原理:对模型的全部参数进行更新,可用于训练模型遵循特定的格式或风格。适用场景:高级别的应用场景,像构建AI智能体与聊天机器人这类系统,它们需要围绕特定主题提供协助、遵守既定的约束规则,并且以特定的方式做出响应。要求:需要大规模的数据集(包含1000组以上的示例提示词对)。

强化学习:

工作原理:借助反馈或偏好信号对模型行为加以调整。模型通过和环境的交互开展学习,并运用反馈持续优化自身。这属于一种复杂的高级技术,把训练与推理相互融合,还能和参数高效微调以及完整微调技术结合运用。具体内容可查阅Unsloth的强化学习指南。适用场景:提高模型在特定领域(例如法律或医学)的准确性,或是打造能够为用户规划并实施动作的自主智能体。所需条件:一个涵盖行为模型、奖励模型以及可供模型学习的环境的流程。

另一个需要考虑的因素是各种方法的显存需求。下表提供了在 Unsloth 上运行每种微调方法的需求概览。

Unsloth:在 NVIDIA GPU 上实现快速微调的高效路径

LLM 微调是一种对内存和计算要求极高的工作负载,在每个训练步骤中都需要进行以十亿次记的矩阵乘法来更新模型权重。这类重型并行计算需要依托 NVIDIA GPU 的强大算力,才能高效、快速地完成。

Unsloth 在这类负载中表现出色,可将复杂的数学运算转化为高效的定制 GPU kernel,从而加速 AI 训练。

Unsloth 可在 NVIDIA GPU 上将 Hugging Face transformers 库的性能提升至 2.5 倍。这些针对 GPU 的优化与 Unsloth 的易用性相结合,使微调对更广泛的 AI 爱好者和开发者更加易于上手。

框架专为 NVIDIA 硬件构建并优化,覆盖从 GeForce RTX 笔记本电脑,到 RTX PRO 工作站以及 DGX Spark,在降低显存占用的同时提供巅峰性能。

Unsloth 提供了一系列实用的指南,帮助用户快速上手并管理不同的 LLM 配置、超参数和选项,以及示例 notebook 和分步骤工作流程。

访问以下链接查看 Unsloth 指南:

● Fine-Tuning LLMs With NVIDIA RTX 50 Series GPUs and Unsloth

● Fine-Tuning LLMs With NVIDIA DGX Spark and Unsloth

查看链接了解如何在 NVIDIA DGX Spark 上安装 Unsloth。阅读 NVIDIA 技术博客,深入了解在 NVIDIA Blackwell 平台上进行微调和强化学习的相关内容。

现已发布:NVIDIA Nemotron 3 开放模型系列

全新的Nemotron 3开放模型系列涵盖Nano、Super和Ultra三种不同规模,它依托全新的异构潜在混合专家(Mixture-of-Experts, MoE)架构构建而成,是一套兼具领先准确率与高效率的开放模型系列,十分适合用来搭建代理式AI应用。

目前已发布的 Nemotron 3 Nano 30B-A3B 是该系列中计算效率最高的模型,针对软件调试、内容摘要、AI 助手工作流和信息检索等任务进行了优化,具备较低的推理成本。其异构 MoE 设计带来以下优势:

推理 token 数量最多减少 60%,显著降低推理成本。支持 100 万 token 的上下文处理能力,使模型在长时间、多步骤任务中能够保留更多信息。

Nemotron 3 Super 是一款面向多智能体应用的高精度推理模型,而 Nemotron 3 Ultra 则适用于复杂的 AI 应用。这两款模型预计将在 2026 年上半年推出。

NVIDIA 于 12 月 15 日还发布了一套开放的训练数据集合集以及先进的强化学习库。Nemotron 3 Nano 的微调现已在 Unsloth 上提供。

Nemotron 3 Nano 现可在 Hugging Face 获取,或通过 Llama.cpp 和 LM Studio 进行体验。

DGX Spark:紧凑而强大的 AI 算力引擎

DGX Spark 支持本地微调,将强大的 AI 性能集成在紧凑的桌面级超级计算机形态中,让开发者获得比普通 PC 更多的内存资源。

DGX Spark 依托 NVIDIA Grace Blackwell 架构构建,其 FP4 AI 性能峰值可达 1 PFLOP,同时拥有 128GB 的 CPU-GPU 统一内存,助力开发者在本地开展更大规模模型、更长上下文窗口以及更高负载训练任务的运行工作。

在微调方面,DGX Spark 可实现:

支持更大规模的模型。对于参数规模在30B以上的模型,消费级GPU的VRAM容量通常难以满足需求,但在DGX Spark的统一内存里却能轻松运行。支持更先进的训练技术。无论是完整微调还是基于强化学习的工作流,都对内存和吞吐量有着更高的要求,而在DGX Spark上运行这类任务,速度会有明显提升。本地自主掌控,无需在云端排队等待。开发者可在本地直接处理高计算负载的任务,不必耗费时间等待云端实例,也无需费心管理多个环境。

DGX Spark 的优势不仅限于在 LLM 上。高分辨率扩散模型通常需要超过普通桌面系统所能提供的内存。借助 FP4 支持和大容量统一内存,DGX Spark 可在短短几秒内生成1000张图像,并为创意或多模态工作流提供更高的持续吞吐量。

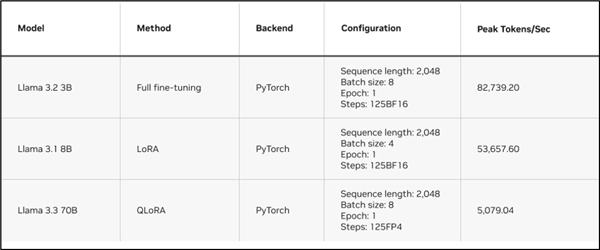

下表展示了在 DGX Spark 上对 Llama 系列模型进行微调的性能表现。

随着微调工作流的不断发展,全新的 Nemotron 3 开放模型系列为 RTX 系统和 DGX Spark 提供了可扩展的推理能力与长上下文性能优化。

请访问链接了解 DGX Spark 如何支持高强度 AI 任务。

#别错过 — NVIDIA RTX AI PC 的最新进展

?FLUX.2 图像生成模型现已发布,并针对 NVIDIA RTX GPU 进行优化

Black Forest Labs 推出的新模型支持 FP8 量化,可降低显存占用并将性能提升40%。

✨Nexa.ai 通过 Hyperlink 为 RTX PC 扩展本地 AI,实现代理式搜索

这款全新的本地搜索智能体能让检索增强生成(RAG)的索引速度提高3倍,LLM推理速度加快2倍——原本需要约15分钟完成索引的1GB高密度文件夹,现在仅需4到5分钟就能搞定。而DeepSeek OCR也已借助NexaSDK以GGUF格式实现本地运行,在RTX GPU上可以即插即用,轻松解析图表、公式以及多语言PDF文件。

? Mistral AI 发布全新模型家族,并针对 NVIDIA GPU 进行优化

全新的 Mistral 3 模型从云端到边缘端均经过优化,可通过 Ollama 和 Llama.cpp 进行快速的本地实验。

? Blender 5.0 正式发布,带来 HDR 色彩与性能提升

本次版本新增 ACES 2.0 广色域/HDR 色彩支持,加入 NVIDIA DLSS,可将毛发与皮毛渲染速度提升最高达 5 倍,并改进了对大规模几何体的处理能力,同时为 Grease Pencil 增加了动态模糊效果。

NVIDIA RTX AI PC的相关信息请关注微博、抖音及哔哩哔哩官方账号。

软件产品信息请查看声明。

热门文章

火环冰队的组队方法是什么

在热门游戏里,火环冰队的搭配能带来别具一格的战斗体验。下面为大家分享一套实用的组队攻略。 核心角色选择 -火属性输出核心:挑选拥有高爆发火技能的角色,像可以瞬间施展大范围高伤害火环的角色就很合适。这类角色在战斗一开始就能对敌人造成强力攻击,快速降低敌方的生命值。 -冰属性控制型角色:拥有强力冰系控制技能的角色是队伍里必不可少的存在。这类角色可以是能将敌人冻结使其无法行动的,也可以是能制造出减速区域影响敌人移动的。借助冰属性控制效果,能够有效限制敌人的行动能力,从而为整个团队营造出良好的输出空间。 辅助型角色的作用十分关键,他们能够为队伍带来增伤、回血等各类辅助效果。举例来说,有的辅助角色可以增强火属性伤害输出,还有的能在队友生命值下降时迅速为其恢复血量。 组队搭配思路 -利用火环的高爆发伤害作为主要输出手段,在战斗开始时集中火力攻击敌方关键目标。 冰属性控制型角色可把握时机施展技能,通过冻结敌人或创造减速区域,既能阻挡敌人接近我方输出核心,又能扰乱敌方的进攻节奏。 辅助角色时刻留意队友的状态,及时为火属性输出核心提供增伤效果,助力其打出更高伤害;当队友受伤时,他们会迅速为队友回血,保障团队的生存能力。 战斗技巧 战斗开场阶段,火属性的核心输出角色率先施放大范围的火环技能,以此对敌方全体造成高额伤害;与此同时,冰属性的控制型角色同步释放冰系控制技能,将敌方前排单位或关键输出点冻结限制。 在战斗时,要依据敌方的行动来调整技能的释放时机。要是敌方冲破了我方的防线,冰属性的控制角色就得马上在他们的行进路径上释放减速或冻结技能,以此阻拦其继续前进。 -辅助角色要时刻留意队友血量,及时使用回血技能。同时,持续为火属性输出核心提供增伤效果,保持其输出能力。 -当敌方有强力技能准备释放时,提前预判,利用冰属性控制技能打断敌方技能释放,保护我方团队。 实战演练 在实际战斗里,依照上述的组队方式与战斗技巧来执行操作。持续借助实战来打磨团队之间的配合,熟练掌握每个角色技能的释放时机。经过多次战斗积累相应经验,就能让火环冰队在游戏里展现出强劲的实力,从容应对各类挑战,赢得胜利。

在热门游戏里,火环冰队的搭配能带来别具一格的战斗体验。下面为大家分享一套实用的组队攻略。 核心角色选择 -火属性输出核心:挑选拥有高爆发火技能的角色,像可以瞬间施展大范围高伤害火环的角色就很合适。这类角色在战斗一开始就能对敌人造成强力攻击,快速降低敌方的生命值。 -冰属性控制型角色:拥有强力冰系控制技能的角色是队伍里必不可少的存在。这类角色可以是能将敌人冻结使其无法行动的,也可以是能制造出减速区域影响敌人移动的。借助冰属性控制效果,能够有效限制敌人的行动能力,从而为整个团队营造出良好的输出空间。 辅助型角色的作用十分关键,他们能够为队伍带来增伤、回血等各类辅助效果。举例来说,有的辅助角色可以增强火属性伤害输出,还有的能在队友生命值下降时迅速为其恢复血量。 组队搭配思路 -利用火环的高爆发伤害作为主要输出手段,在战斗开始时集中火力攻击敌方关键目标。 冰属性控制型角色可把握时机施展技能,通过冻结敌人或创造减速区域,既能阻挡敌人接近我方输出核心,又能扰乱敌方的进攻节奏。 辅助角色时刻留意队友的状态,及时为火属性输出核心提供增伤效果,助力其打出更高伤害;当队友受伤时,他们会迅速为队友回血,保障团队的生存能力。 战斗技巧 战斗开场阶段,火属性的核心输出角色率先施放大范围的火环技能,以此对敌方全体造成高额伤害;与此同时,冰属性的控制型角色同步释放冰系控制技能,将敌方前排单位或关键输出点冻结限制。 在战斗时,要依据敌方的行动来调整技能的释放时机。要是敌方冲破了我方的防线,冰属性的控制角色就得马上在他们的行进路径上释放减速或冻结技能,以此阻拦其继续前进。 -辅助角色要时刻留意队友血量,及时使用回血技能。同时,持续为火属性输出核心提供增伤效果,保持其输出能力。 -当敌方有强力技能准备释放时,提前预判,利用冰属性控制技能打断敌方技能释放,保护我方团队。 实战演练 在实际战斗里,依照上述的组队方式与战斗技巧来执行操作。持续借助实战来打磨团队之间的配合,熟练掌握每个角色技能的释放时机。经过多次战斗积累相应经验,就能让火环冰队在游戏里展现出强劲的实力,从容应对各类挑战,赢得胜利。- 伊瑟开服卡池该怎么选

- 在洛克王国里怎样才能获得哭哭菇

- 厉害的0516铃铛怎么样

- 嘟嘟脸恶作剧里的小桃表现如何

- 猴面小龙兰具有哪些特征?

- 无主之地4里唱片骑师这把武器的具体效果是怎样的

- 黑龙江全省事app养老金认证操作指南

- 全民K歌里怎么才能只演唱歌曲的部分片段呢

- 怎样使用台风路径查询app